Roblox met en œuvre un changement structurel important sur sa plate-forme en introduisant des types de comptes spécialisés adaptés à des groupes d’âge spécifiques. Cette décision marque la transition d’un modèle « taille unique » vers un écosystème plus segmenté, conçu pour répondre aux préoccupations croissantes des parents concernant la sécurité en ligne et la pertinence du contenu.

La nouvelle structure de compte

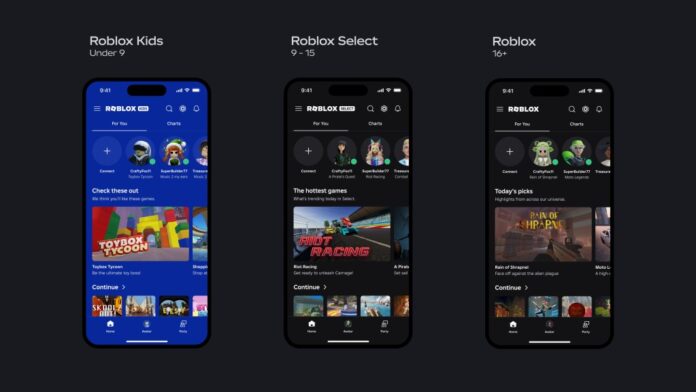

La mise à jour introduit deux niveaux d’accès distincts, passant d’une expérience de plate-forme unique à des environnements adaptés à l’âge :

- Roblox Kids (5 à 8 ans) : Un environnement hautement organisé conçu pour les utilisateurs de la petite enfance.

- Roblox Select (9 à 15 ans) : Une expérience de niveau intermédiaire qui équilibre un gameplay plus complexe avec des garde-corps de sécurité améliorés.

Ce changement est une réponse directe aux risques inhérents au contenu généré par les utilisateurs. Si l’immense bibliothèque de jeux créés par la communauté constitue sa plus grande force, elle constitue également son plus grand handicap, exposant fréquemment les jeunes utilisateurs à des thèmes matures ou à des interactions sociales non modérées.

Filtrage et conservation de contenu améliorés

Auparavant, Roblox s’appuyait fortement sur les contrôles parentaux manuels et les évaluations générales du contenu. Dans le cadre du nouveau système, la plateforme joue un rôle plus proactif dans la modération du contenu :

- Vérification du développeur : Garantir que les créateurs d’expériences répondent à des normes spécifiques.

- Évaluation étendue du contenu : Mise en œuvre d’un processus d’évaluation plus rigoureux pour les jeux destinés à un public plus jeune.

- Garde-corps automatisés : Au lieu d’exiger des parents qu’ils activent manuellement chaque paramètre, la plate-forme limitera automatiquement l’accès aux expériences jugées inappropriées pour des tranches d’âge spécifiques.

Contrôle parental étendu

Pour compléter les niveaux automatisés basés sur l’âge, Roblox met à niveau sa suite d’outils de gestion parentale. Ces mises à jour visent à réduire la « fatigue de configuration » à laquelle les parents sont souvent confrontés lorsqu’ils tentent de sécuriser les espaces numériques de leurs enfants. Les nouvelles fonctionnalités clés incluent :

- Gestion granulaire du chat : Contrôler qui peut communiquer avec l’enfant.

- Content Gating : Restreindre l’accès à des types spécifiques de jeux ou d’expériences.

- Limites de temps et de budget : Gérer la durée pendant laquelle un enfant joue et combien il dépense en achats dans le jeu.

Les défis à venir : pourquoi la sécurité n’est jamais « résolue »

Même si ces mises à jour représentent une avancée majeure, elles ne constituent pas une solution totale aux complexités de la sécurité numérique. Plusieurs défis systémiques demeurent :

- La nature du contenu généré par les utilisateurs : Étant donné que la plate-forme évolue constamment avec de nouveaux jeux créés par les utilisateurs, les systèmes de modération, aussi avancés soient-ils, peuvent avoir du mal à détecter le contenu problématique en temps réel.

- Précision de l’âge : L’efficacité de ces niveaux repose sur la fourniture par les utilisateurs d’informations véridiques sur l’âge, un obstacle courant dans les environnements en ligne.

- La nécessité de la supervision : Les outils automatisés peuvent servir de filet de sécurité, mais ils ne peuvent pas remplacer la participation active des parents et l’éducation à la culture numérique.

L’essentiel : Roblox évolue vers une plate-forme plus structurée et sensible à l’âge, mais ces protections techniques sont plus efficaces lorsqu’elles sont associées à une supervision parentale active et à des examens réguliers des comptes.